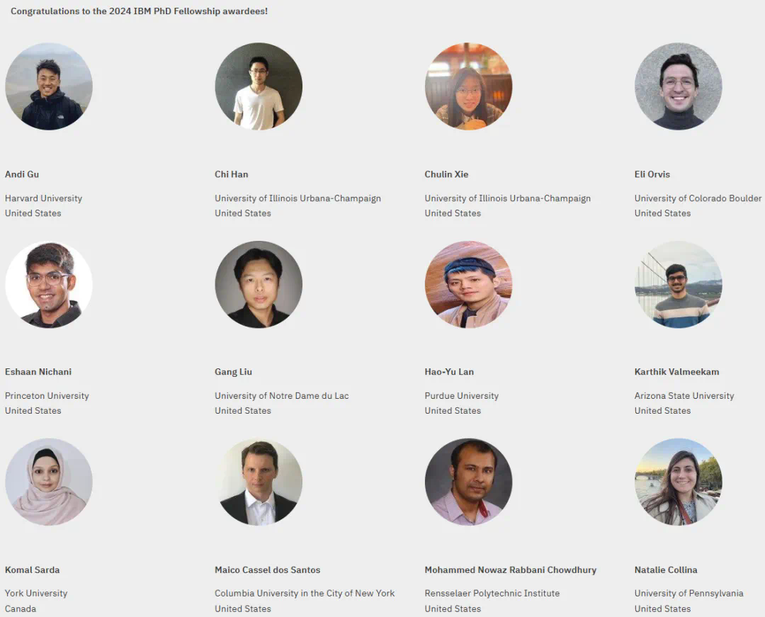

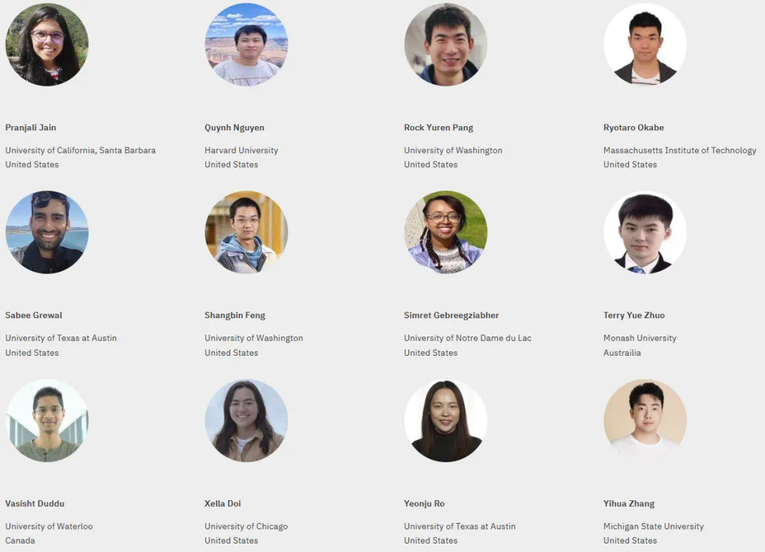

清华、浙大、西南大学、西安交大、华中科技大学、台*大学…… 多位 2024 IBM 博士生奖学金获得者毕业于国内高校。其中有你的校友吗?

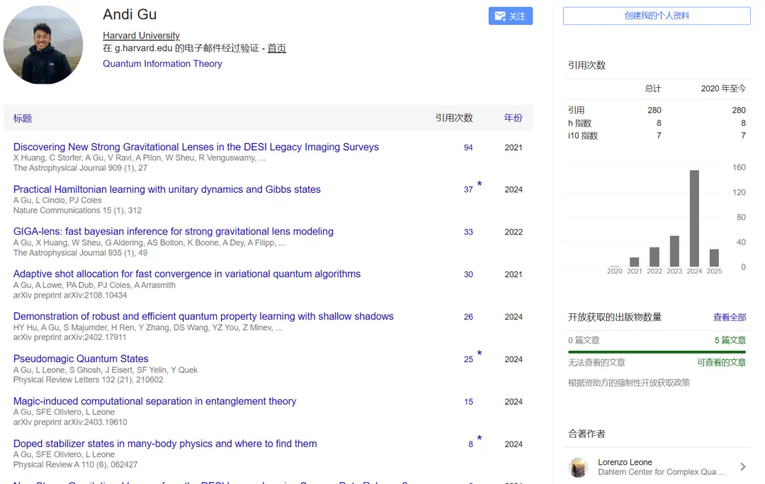

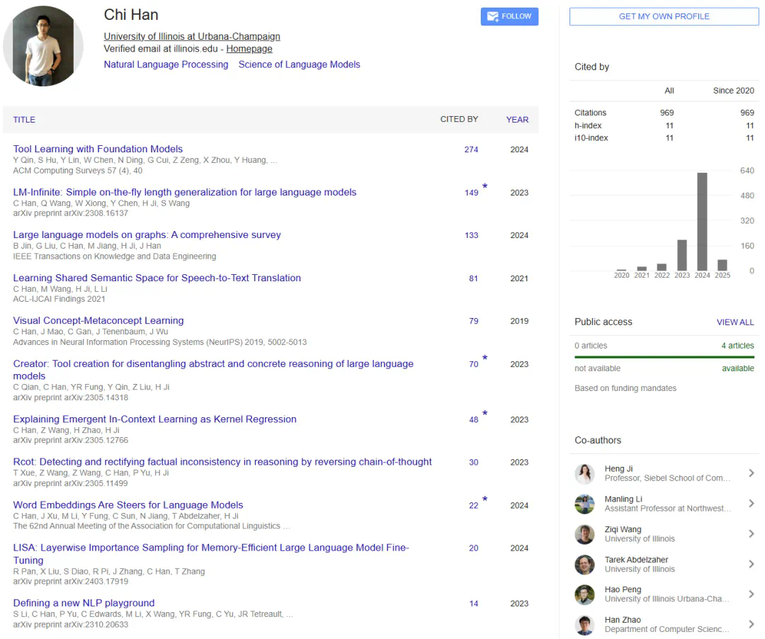

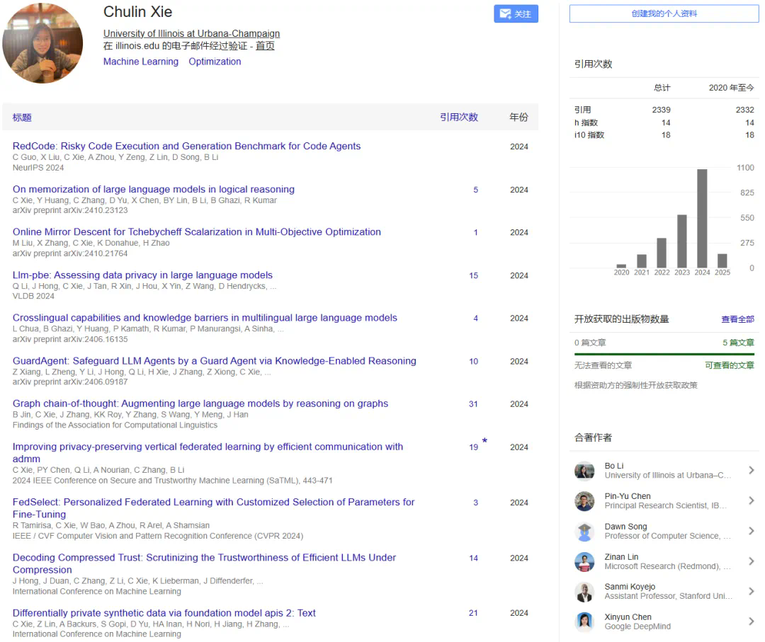

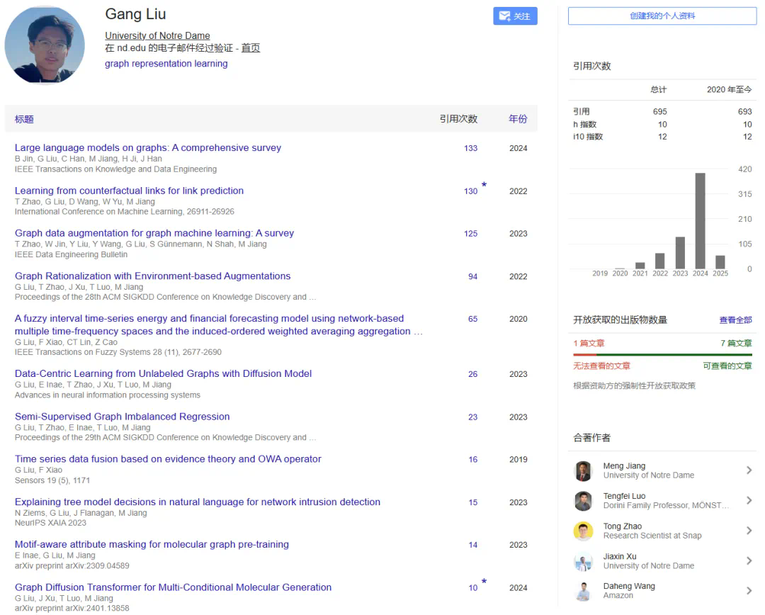

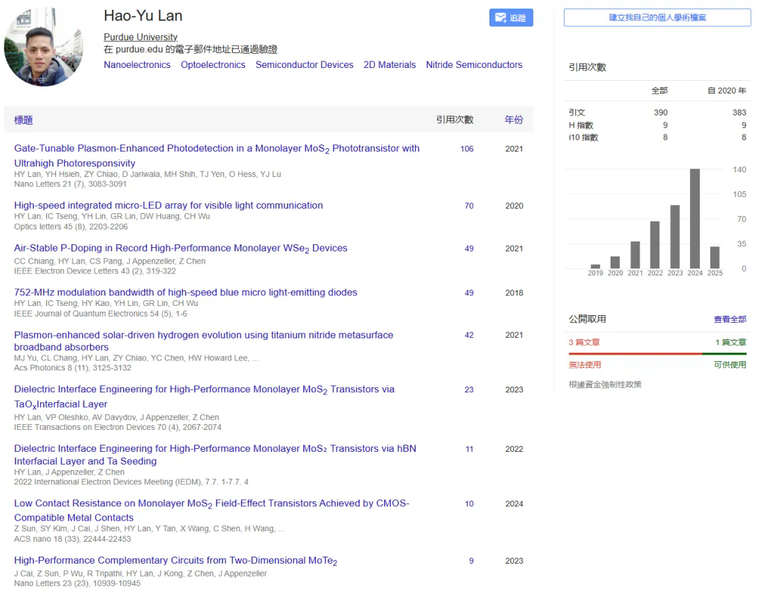

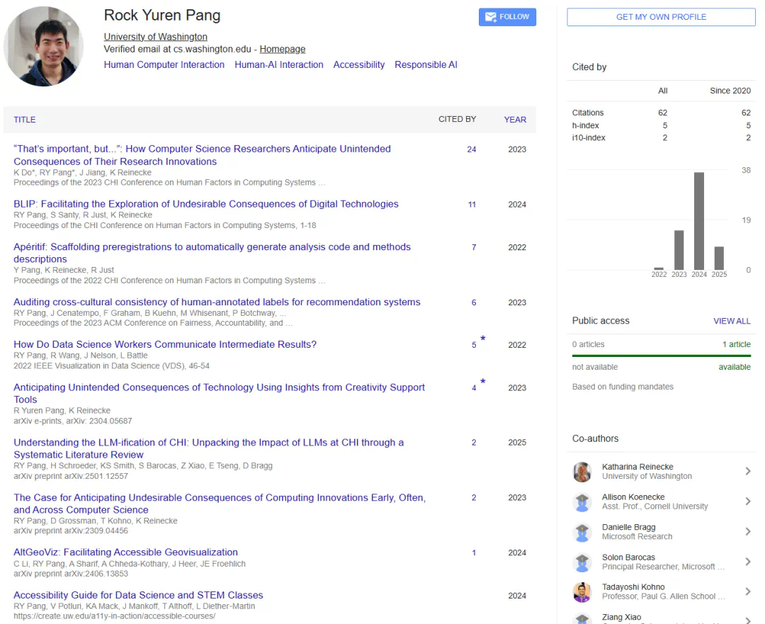

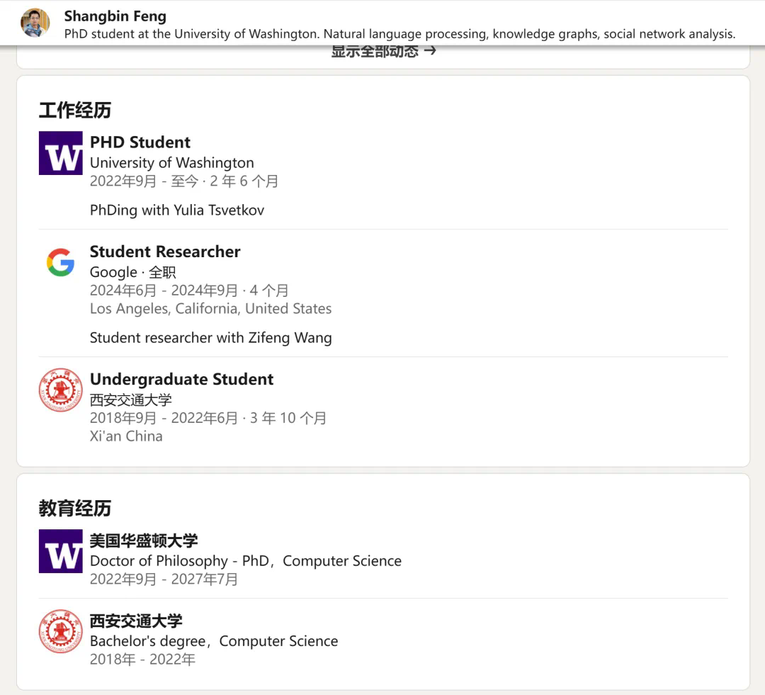

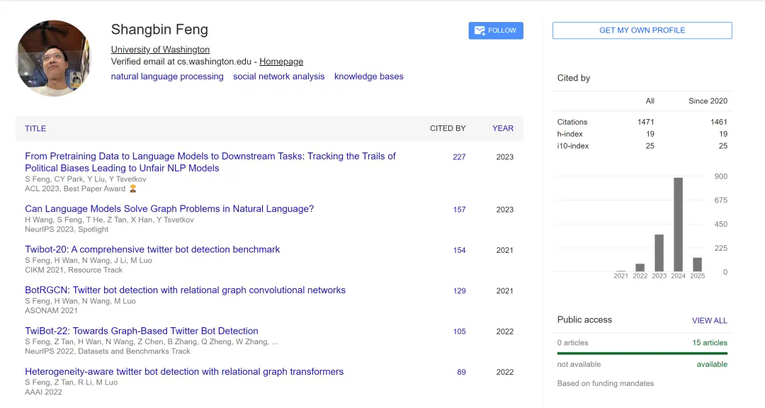

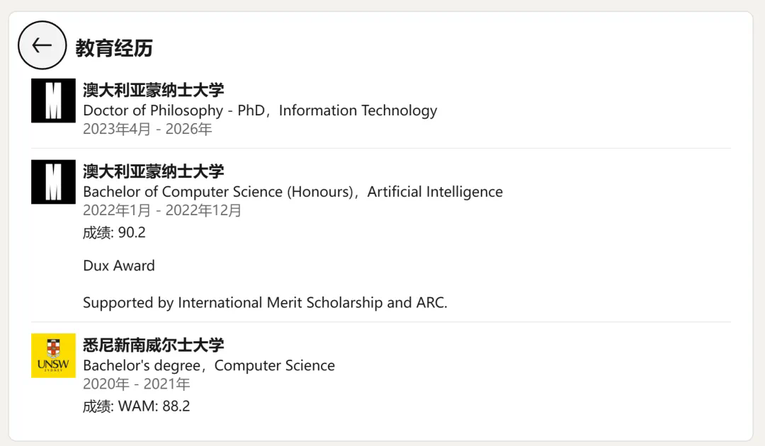

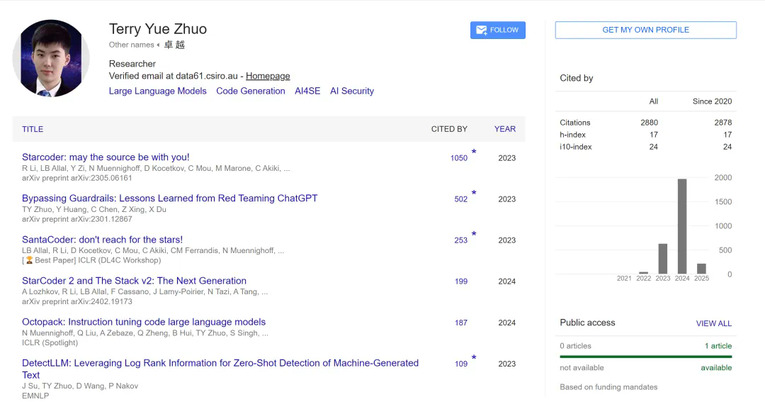

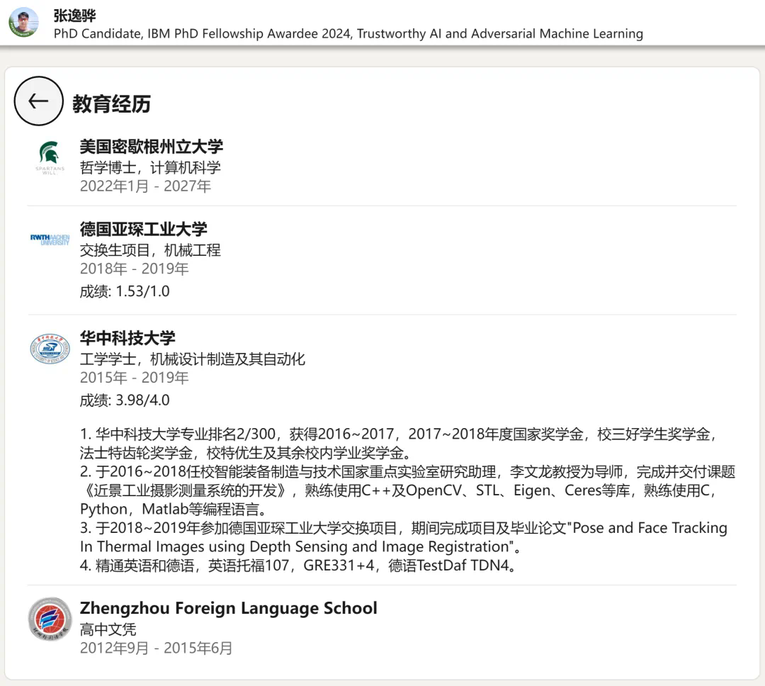

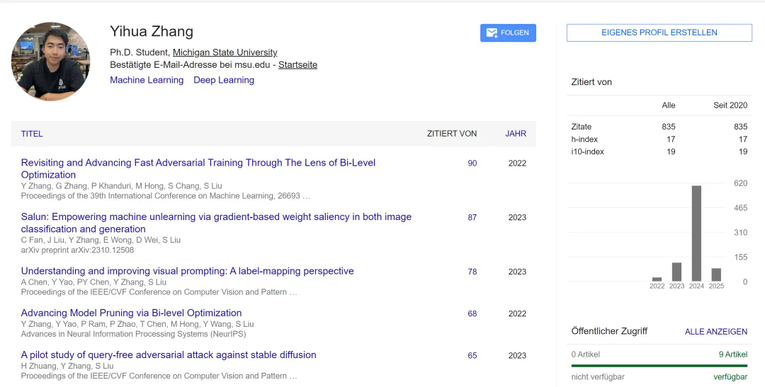

IBM 博士生奖学金(IBM PhD Fellowship Awards)刚刚公布了 2024 年的获奖者名单。相较于去年,今年的获奖者数量大幅提升,从 10 人增至 24 人,其中华人获奖者数量也从去年的 6 人升至 9 人。据了解,IBM 博士生奖学金是一个颇有历史的奖学金,自 1951 年以来就一直在「表彰和奖励世界各地的优秀博士生」。也因此,这个奖学金的竞争非常激烈,每年都有大量申请者。2024 年 IBM 博士生奖学金收到了来自 11 个国家 / 地区 76 所大学的数百份申请。经由 IBM 的技术专家审核,最终选出了这份有 24 人的获奖者名单。这些获奖者不仅已有卓越的学术成就,还提供了创新的研究提案,涉及的领域包括半导体技术、人工智能、混合云计算、安全、量子计算和负责任计算等前沿研究领域。个人主页:https://andigu.github.io/Andi Gu 是哈佛大学量子科学与工程项目的博士生,研究方向是量子信息与物理学的交叉领域。他本科毕业于加利福尼亚大学伯克利分校。他表示:「总体来说,我对复杂性问题非常感兴趣。」其中既有物理系统中的复杂性,也包含计算机科学中的算法复杂性。个人主页:https://glaciohound.github.io/韩迟(Chi Han)的长期研究目标是发展语言模型科学(the science of language models)。他表示自己的研究方向是解答这些问题:每个隐藏表示在 LLM 中扮演什么角色?它们何时会出现故障或导致违反直觉的现象?我们如何调整机制以超越其固有限制并更好地服务于下游任务?为此,他一直在对 LLM 隐藏表示 LM 进行理论和实证分析,旨在提供见解并为 LM 开发有用的工具和解决方案。此外,AI 与机器学习的包容性也是其感兴趣的课题。他是 ACL 2024 杰出论文《Word Embeddings Are Steers for Language Models》以及 NAACL 2024 杰出论文《LM-Infinite: Zero-Shot Extreme Length Generalization for Large Language Models》的第一作者。另外,韩迟不仅获得了 IBM 博士奖学金,也获得了 2025-2026 年度的亚马逊 AICE 博士奖学金。韩迟的导师是 Heng Ji。此前,他于清华大学姚班获得学士学位。预计 2026 年 6 月毕业。Chulin Xie 伊利诺伊大学厄巴纳 — 香槟分校个人主页:https://alphapav.github.io/Chulin Xie 的研究方向主要是可信机器学习和优化,本科毕业于浙江大学。她是 NeurIPS 2023 杰出论文《DecodingTrust: A Comprehensive Assessment of Trustworthiness in GPT Models》的共一作者,该论文为评估 GPT 的可信度构建了一个系统性的基准。个人主页:https://liugangcode.github.io/刘罡(Gang Liu)是圣母大学计算机科学与工程专业四年级博士生。他于 2021 年在中国西南大学获得软件工程学士学位。他的研究方向包括图机器学习的数据和学习基础、图机器学习的模型基础(包括生成式模型、多模态分子表征学习、多模态大型语言模型)、将图机器学习用于科学发现(尤其是新材料)。Hao-Yu Lan 是普渡大学电气与计算机工程系在读博士,研究方向是超越 CMOS 时代的、基于二维半导体的纳米电子学。他本科毕业于成功大学,后在台*大学取得硕士学位,并在台积电担任过研发工程师。个人主页:https://homes.cs.washington.edu/~ypang2/逄郁任(Rock Yuren Pang)是华盛顿大学 Paul G. Allen 计算机科学与工程学院的五年级博士生。他的研究主题是负责任的人工智能和人机交互,目标是将负责任计算的目标与计算研究实践的现实相结合。他表示:「我目前的研究重心是构建新工具,以支持研究人员和从业者了解现有的大规模偏见,并利用群体智慧预测潜在的不利影响。」他还对可获得性、数据可视化、技术和 HCI 的跨文化可用性感兴趣。逄郁任是一位山东省青岛第二中学校友,之后在玛卡莱斯特学院获得了数学学士学位。冯尚彬(Shangbin Feng)本科就读于西安交通大学,现在华盛顿大学攻读博士学位,师从 Yulia Tsvetkov。他的研究领域包括自然语言处理、知识图谱、社交网络分析等。2023 年,冯尚彬以一作身份撰写的论文《From Pretraining Data to Language Models to Downstream Tasks: Tracking the Trails of Political Biases Leading to Unfair NLP Models》拿到了 ACL 2023 最佳论文奖。2024 年,他的一作论文《Don't Hallucinate, Abstain: Identifying LLM Knowledge Gaps via Multi-LLM Collaboration》拿到了 ACL 2024 杰出论文奖。个人主页:https://bunsenfeng.github.io/卓越(Terry Yue Zhuo) 目前在 CSIRO 的 Data61 和蒙纳士大学攻读博士学位。他现任计算机智能项目(Computer Intelligence Project)的负责人,这是由 Meta 和 IBM 牵头的 AI 联盟(AI Alliance)的核心项目。他的研究重点是计算机级代码智能,特别是函数调用、代码生成和智能体工作流程。他同时也在软件工程领域开展研究(如漏洞检测和移动应用程序)。他的长期目标是通过代码 / 可执行语言构建通用人工智能(AGI)。他目前正在开发用于人工智能编码和自动化软件开发的开放评估平台 ——SWE Arena。该平台能够实时执行和渲染任何代码,完全免费使用,并将很快开源。他近期一作的 ICLR 2025 论文《BigCodeBench: Benchmarking Code Generation with Diverse Function Calls and Complex Instructions》是该会议得分前五的论文之一。该论文提出了一个新基准 BigCodeBench,可通过要求 LLM 调用来自 139 个库和 7 个领域的多个函数调用作为工具来执行 1140 个细粒度任务,从而可以评估 LLM 通过程序解决具有挑战性和实际任务的能力。此外,他参与的论文《SantaCoder: don't reach for the stars!》获得过 ICLR 2023 最佳论文奖。今年,他将在苏州举办的 EMNLP'25 会议上组织首个「NLP + 代码:语言模型中的代码智能」专题讲座。 张逸骅(Yihua Zhang)高中毕业于郑州外国语学校,本科毕业于华中科技大学,现在是密歇根州立大学 OPTML 研究组的四年级博士生,师从 Sijia Liu 教授。他的研究重点是大型语言模型和扩散模型的可信和可扩展机器学习算法,特别关注理论基础与实际应用的结合。个人主页:https://www.yihua-zhang.com/除了 IBM 博士生奖学金,张逸骅还获得过 2025 年 CPAL 新星奖,以及 2024 年 MLCommons 新星奖等重要荣誉。张逸骅曾在 Meta AI、亚马逊 AWS AI 实验室和思科研究院等科技公司实习,积累了宝贵的行业经验。他致力于开发高效、可扩展且稳健的机器学习算法,以应对这些领域的挑战。

2024 IBM博士生奖学金出炉:韩迟、卓越、张逸骅、冯尚彬等AI研究者入选 -

AI 资讯 - 资讯 -

AI 中文社区

声明:本文转载自机器之心,转载目的在于传递更多信息,并不代表本社区赞同其观点和对其真实性负责,本文只提供参考并不构成任何建议,若有版权等问题,点击这里查看更多信息!本站拥有对此声明的最终解释权。如涉及作品内容、版权和其它问题,请联系我们删除,我方收到通知后第一时间删除内容。

AI 中文社

AI 中文社